Lorsqu’il n’était qu’un enfant, Oriol Vinyals (Sabadell, 1983) aimait poser à son père des questions sur les mathématiques pendant qu’ils gravissaient la montagne de La Mola. Adolescent, il fréquente les cybercafés pour jouer au jeu vidéo StarCraft et devient fasciné par le film. 2001 : Une odyssée de l’espace. Il ne savait pas que cette passion serait sa porte d’entrée vers Google. Aujourd’hui, à 42 ans, il est une autorité mondiale reconnue en matière d’apprentissage profond (apprentissage profond), l’une des techniques les plus avancées en matière d’intelligence artificielle.

Ce mathématicien et ingénieur informaticien catalan est, depuis 2016, vice-président de la recherche chez Google DeepMind, le célèbre laboratoire d’IA du géant technologique californien. À partir de là, il dirige le développement technique de Gemini, un rival de ChatGPT et actuellement le modèle de langage le plus puissant qui existe. L’influence de ses recherches ne fait aucun doute : il est le cinquième scientifique le plus cité au monde dans son domaine.

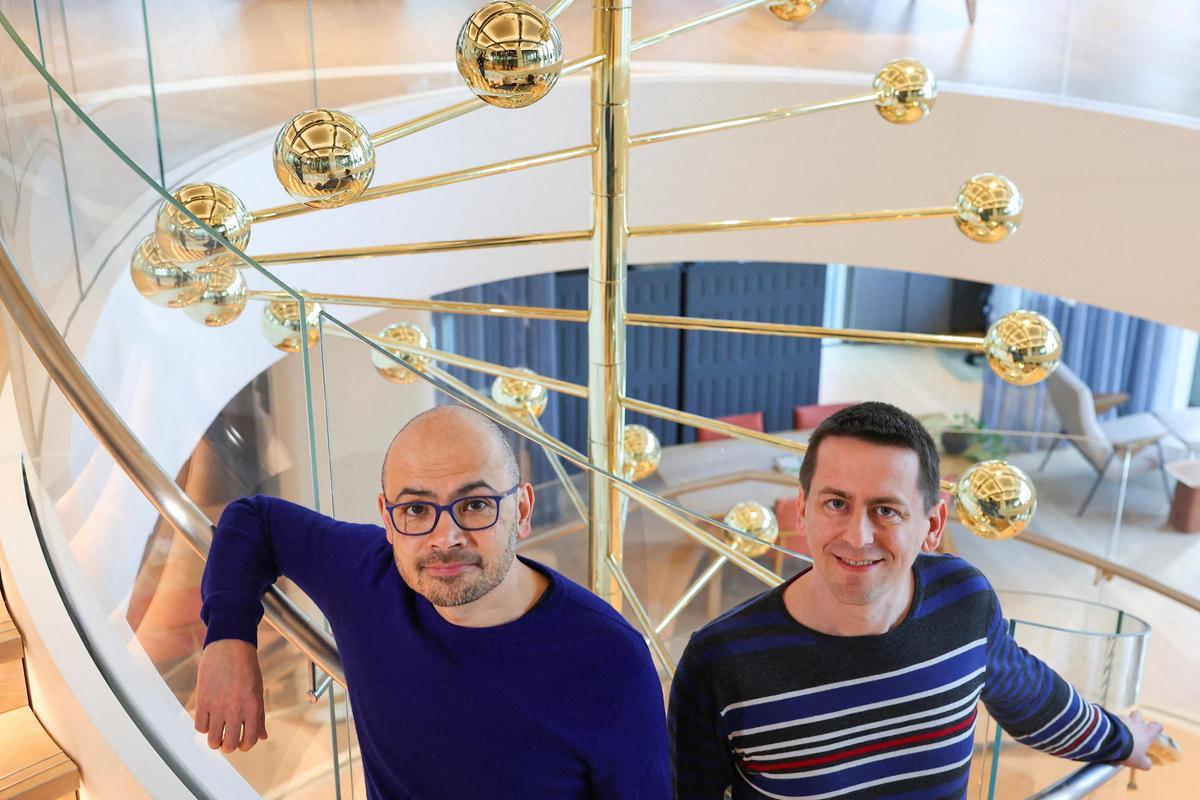

Vinyals s’occupe d’EL PERIÓDICO avant d’être investi comme médecin honoris causa par l’Université Pompeu Fabra (UPF), alma mater dans lequel il a complété un double diplôme avant d’obtenir un doctorat à l’Université de Californie à Berkeley et, de là, de faire le grand saut vers la Silicon Valley.

La semaine dernière, vous avez lancé Gemini 3, votre modèle d’IA le plus puissant, et même Sam Altman a reconnu en interne que les avancées de Google pourraient « créer des obstacles économiques temporaires » à OpenAI. Quel saut cela implique-t-il ?

La formule de base ne change pas grand-chose. Nous avons réalisé un bond significatif dans la pré-formation, la phase dans laquelle nous faisons comprendre au modèle toutes les données sur Internet et leurs corrélations, grâce à des changements dans l’architecture. Et c’est la partie la plus importante. Nous avons également beaucoup amélioré la formation ultérieure, dans laquelle il est adapté à l’utilisation qu’il donnera aux utilisateurs, par exemple pour faire office de chatbot.

Et en quoi échoue-t-il encore ?

Il post-formation C’est le domaine dans lequel il y a le plus de marge de progression. Il nous reste encore beaucoup à découvrir, surtout si on le compare avec les systèmes que nous avons créés pour jouer à des jeux. Avec les grands modèles de langage (LLM), améliorer les performances ne consiste pas à gagner une partie, mais à déterminer si la réponse de Gemini à votre question est bonne, ce qui est beaucoup plus difficile.

Les « applications » de DeepSeek, ChatGPT et Google Gemini / Andreï Rudakov / Bloomberg

Vous lancez des modèles de plus en plus puissants. L’IA peut-elle continuer à évoluer s’il existe un goulot d’étranglement de bonnes données sur lesquelles la former ?

Nous ne devrions pas imaginer que l’IA devienne de plus en plus grande, même si augmenter la taille aide. Si vous rendez le modèle accessible à des millions de personnes, comme le fait Google, vous ne voulez pas qu’il soit très grand, car vous ne pourrez alors pas le commercialiser à bas prix auprès des utilisateurs. L’un des moyens de le faire évoluer consiste à recourir à des innovations scientifiques afin qu’il dépense moins d’énergie pour générer chaque mot. Il est vrai que nous utilisons déjà pratiquement toutes les données de qualité disponibles sur Internet. Mais nous trouvons toujours des moyens de rendre chaque modèle meilleur que le précédent.

Nous utilisons déjà pratiquement toutes les données de qualité disponibles sur Internet

Les modèles de formation avec des données générées par l’IA sont-ils une option ?

Oui, c’est un sujet que nous étudions et c’est une bonne idée qui, à certains égards, donne de bons résultats. Mais cela peut aussi propager les erreurs d’autres modèles et c’est problématique car cela pourrait aggraver les futures IA.

Le rapport État de l’IA 2025 prévient que l’énergie constitue un autre goulot d’étranglement.

Le coût de l’énergie est très élevé, mais c’est un bon changement car cela signifie que la technologie atteint tout le monde. Ce n’est pas un coût exceptionnel car il existe des microprocesseurs de plus en plus performants. Les entreprises qui souhaitent créer l’IA souhaitent également avoir une durabilité économique et investir dans des moyens de réduire ce coût énergétique. Et grâce à la technologie, il sera de plus en plus bas.

Centre de données Google, au bord du fleuve Columbia, aux États-Unis /eau de vaisselle

Mais, comme l’indique le paradoxe de Jevons, l’introduction de technologies plus efficaces peut conduire à une consommation totale d’énergie plus élevée.

Oui, c’est vrai. Lorsque vous ajoutez une voie à l’autoroute, davantage de voitures s’y déplacent. Mais c’est un bon problème, cela signifie que les gens veulent utiliser votre technologie. En termes d’évolutivité, il y a déjà autant de personnes qui utilisent l’IA que la recherche Google. La demande énergétique peut augmenter, mais nous avons prévu que nos centres de données soient neutres en CO2. Or, il est possible que si la demande est très, très importante, Google ait légèrement sous-estimé l’essor informatique dans les années à venir. Il se peut également que des progrès soient réalisés pour répondre à ce besoin énergétique. Il y a plusieurs raisons d’être optimiste, mais soyez toujours vigilant.

Il est possible que, si la demande énergétique est très, très importante, Google ait légèrement sous-estimé l’augmentation de l’informatique dans les années à venir.

Ramón López de Mántaras, un pionnier de l’IA en Espagne, m’a expliqué que les soi-disant hallucinations, erreurs, sont un problème « inhérent » à l’IA générative. N’ont-ils pas de remède ?

C’est le problème, peut-être inhérent, de la formation de modèles avec des données provenant d’Internet. Ce problème ne sera peut-être jamais parfaitement résolu, mais nous savons comment améliorer chaque génération d’IA. Est-ce que ce sera parfait à 100% ? Impossible. Mais nous pouvons minimiser les erreurs. Il y a beaucoup de marge d’amélioration et cela sera corrigé d’abord en anglais plutôt qu’en espagnol ou en catalan.

Chez DeepMind, vous avez réussi à créer des systèmes qui apprennent de leur expérience pour surpasser les humains dans des jeux comme StarCraft ou Go. Cela peut-il être extrapolé à une IA qui comprend le monde ?

C’est plus difficile parce que le monde est plus complexe. Évaluer si l’on gagne ou perd une partie d’un jeu de société est facile, mais c’est beaucoup plus compliqué quand on veut aider des utilisateurs très différents avec une infinité de choses. Ordonner une tâche spécifique comme gagner est facile, mais faire ce que l’utilisateur veut (écrire un poème, résumer un livre, dessiner quelque chose…) n’est pas si facile. La difficulté technique est de savoir évaluer chaque LLM, mais aussi de définir mathématiquement chaque tâche.

Demis Hassabis, PDG de Google DeepMind, affirme que l’IA « apprend à ressentir » et pourrait égaler ou dépasser la cognition humaine avant 2030. Quelles sont les preuves de cela ?

Les modèles sont des simulations probabilistes qui apprennent de la façon dont les humains communiquent, donc ce qu’ils font, c’est simuler ce qu’ils ressentent, ce qu’ils ont des émotions. Il y en a qui sont si avancés dans le langage qu’on peut y voir une certaine personnalité, même s’ils ne sont pas complètement humains. Cette simulation nous aide à comprendre la technologie d’une manière plus humaine et moins comme une machine. Je pense qu’il sera important d’avoir un lien émotionnel à un niveau élevé avec l’IA. Si cet artefact rend la communication plus optimale, nous l’aime davantage et nous aide à résoudre les problèmes quotidiens, alors il sera le bienvenu. Et peut-être que nous ne saurons jamais s’il y a quelque chose sous la surface des mots écrits par le modèle.

Les modèles sont des simulations probabilistes qui apprennent de la façon dont les humains communiquent. Ils simulent donc leurs émotions.

Où se situe la frontière entre compréhension et simulation ?

C’est très difficile. Nous ne comprenons pas encore pleinement comment fonctionne le cerveau humain, donc un nouveau système coûtera très cher. C’est une question passionnante. Aujourd’hui, ces émotions sont clairement simulées.

Vous développez des systèmes qui sont des boîtes noires. Ne savez-vous pas pourquoi ils répondent à ce qu’ils répondent ?

Lorsque le système tombe en panne, vous pouvez essayer de comprendre pourquoi. Par exemple, ce qui est amusant, c’est que nous savons que si vous faites une erreur en identifiant le nombre de R dans le mot fraise Cela peut être dû au fait qu’Internet regorge de ces erreurs et que l’entraînement du modèle avec des données Internet crée un signal erroné qui ne donne pas la bonne réponse. Mais si nous regardons le modèle et cartographions ce qui lui est demandé et ce à quoi il répond, alors il y a beaucoup moins de clarté, comme c’est également le cas avec le fonctionnement de notre esprit. Nous ne comprenons pas très bien notre cerveau après des siècles d’études, et nous ne comprenons pas non plus bien ces nouveaux systèmes.

Demis Hassabis et John M. Jumper, de Google DeepMind, lauréats du prix Nobel de chimie / Toby Melville / Reuters

Ce week-end marque le troisième anniversaire du lancement de ChatGPT, qui a accéléré une carrière commerciale dans le secteur. Comment votre vie a-t-elle changé ?

Depuis mes débuts chez Google en 2013, j’ai vécu plusieurs phases. Au début, tout était très académique, faire des recherches, publier papiers et montrer aux autres que cette technologie était une bonne chose. Lorsque j’ai rejoint DeepMind en 2016, les recherches étaient déjà un peu plus vastes. ChatGPT était très grand public; a créé une nouvelle source d’utilisateurs et ouvert la porte à de nouveaux investissements dans les projets qu’il menait. Maintenant, il y a plus d’intensité et nous sommes plus concentrés. Le modèle (IA) est le moteur des produits que Google distribue désormais. Donc nous tous qui participons au projet sommes à notre meilleur. Même Sergei (Brin, co-fondateur de Google) vient au bureau tous les jours et Sundar (Pichai, PDG) passe des heures à discuter avec l’équipe.

Depuis ChatGPT, il y a plus d’intensité. Même Sergei Brin (co-fondateur de Google) vient au bureau tous les jours.

Comment expliqueriez-vous votre position à quelqu’un qui ne connaît pas l’IA ?

Pour faire court, j’aide l’équipe qui développe des modèles d’IA à prioriser les idées à étudier.

L’industrie insiste pour transformer l’IA en un « agent » qui fait tout à votre place. Quelle vision souhaitez-vous réaliser ?

Dans le monde physique, il y a la robotique, qui donne toujours l’impression qu’elle va créer quelque chose comme ça dans les cinq prochaines années et que cela n’arrive jamais. En numérique, le modèle dont nous faisons la promotion peut avoir accès à Internet et à votre ordinateur pour faire des choses incroyables, comme planifier une réunion ou organiser un voyage. Au-delà des questions d’utilisabilité et de sécurité que nous étudions, je pense que ces « agents » deviendront populaires dans les années à venir. Elle est déjà appliquée dans le domaine scientifique – moi-même – et cette automatisation peut aider les scientifiques et générer des progrès considérables dans des niches telles que l’IA, les supermatériaux ou l’énergie de fusion.

La plus grande réussite de DeepMind est AlphaFold, qui a remporté le prix Nobel de chimie. La science est-elle le domaine le plus fertile pour l’IA ?

Il existe un préjugé selon lequel nous appliquons l’IA à la science parce que ceux d’entre nous qui l’ont créée sont des scientifiques. Mais il existe également de nombreuses opportunités dans les domaines à fort impact.

Abonnez-vous pour continuer la lecture