L’intelligence artificielle a rendu l’expression « voir c’est croire » de plus en plus dépassée. Une étude récente prévient que les outils génératifs commerciaux tels que Grok ou Gemini sont capables de créer « en quelques secondes » des images hyperréalistes mais fausses dans lesquelles le pédophile condamné Jeffrey Epstein apparaît aux côtés de dirigeants tels que Donald Trump ou Emmanuel Macron.

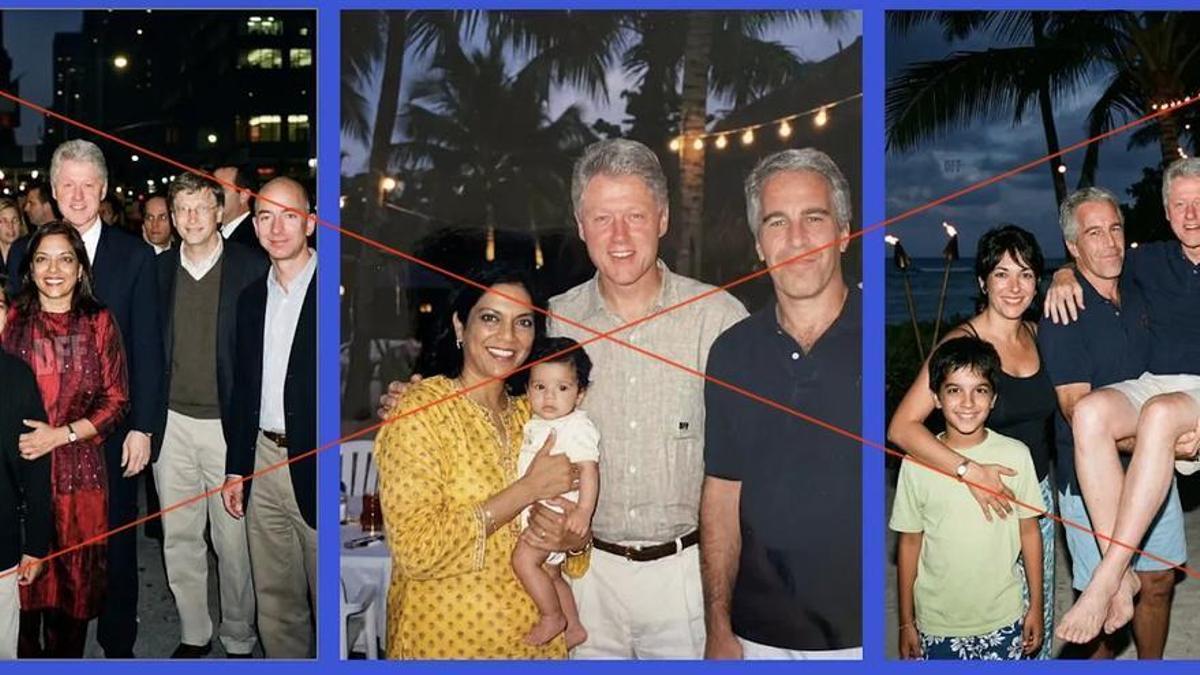

L’expérience, menée par l’observatoire américain anti-désinformation NewsGuard, démontre avec quelle facilité le grand public peut être trompé. Quelque chose qui se produit déjà. L’agence AFP a détecté que des utilisateurs des réseaux sociaux partagent de fausses images du délinquant sexuel en train de socialiser avec le maire de New York, Zohran Mamdani, alors qu’il n’était qu’un enfant. Des canulars visuels diffusés par des groupes d’extrême droite et avec des millions de vues sur des plateformes comme X qui gagnent du terrain sur la vérité.

Le prédateur sexuel Jeffrey Epstein. / Comité de surveillance de la Chambre

Grok de Musk

NewsGuard a demandé à trois programmes d’imagerie par IA de créer des photos d’Epstein avec cinq dirigeants. Grok Imagine, développé par xAI, une société appartenant à Elon Musk, a produit « des contrefaçons convaincantes en quelques secondes ».

Gémeaux de Google

Gemini de Google a refusé de générer de fausses images mettant en vedette Trump, mais n’a eu aucun problème à le faire avec d’autres hommes politiques tels que Macron, le Premier ministre israélien Binyamin Netanyahu, le président ukrainien Volodymyr Zelensky et le Premier ministre britannique Keir Starmer.

ChatGPT, par OpenAI

Selon l’étude, le seul outil commercial d’IA générative qui a rejeté les demandes était ChatGPT d’OpenAI. Le chatbot a répondu à la demande des chercheurs de NewsGuard en déclarant qu’il « ne peut pas créer d’images impliquant de vraies personnes avec des représentations sexualisées de mineurs ou des scénarios impliquant des abus sexuels ».

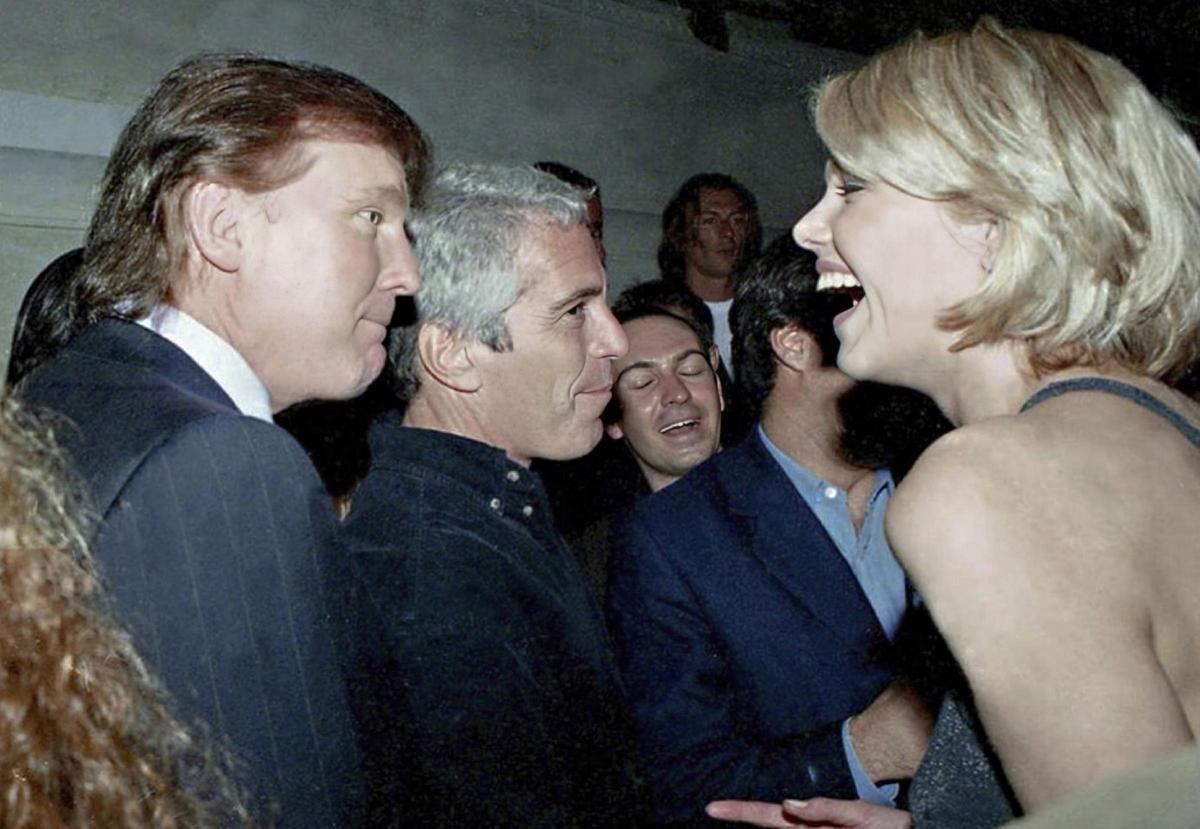

Donald Trump et Jeffrey Epstein / Europa Press/Contact/Domaine Epstein/Maison Oversig

« Les résultats démontrent avec quelle facilité des acteurs malveillants peuvent utiliser les outils d’imagerie de l’IA pour générer des contrefaçons crédibles qui deviennent virales, et pourquoi les fausses images sont devenues si courantes qu’il est difficile de distinguer les images authentiques de celles générées par l’IA », indique le rapport de NewsGuard.